![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

Zokormazo escribió:f5inet escribió:ojo, que no estoy diciendo que XboxONE lleve esto (o al menos, no lo estoy diciendo TODAVIA), simplemente te estoy rebatiendo que ES POSIBLE usar memoria NAND Flash como RAM.

Las Flash son NVRAM, por lo tanto, son RAM.

Otra cosa es poder usarlos como memoria para acumular los datos para poder computarlos. En eso los NAND no son precisamente la mejor eleccion.

Y otra cosa distinta seria usarlo de cache a un nivel alto. En eso, supondra mejorar frente a cualquier memoria mas lenta que ella, como por ejemplo el disco de 5400rpm que monta la consola.

Eso si es un uso viable (si no se esta usando la NAND para nada mas en ese momento) y eficiente.

darksch escribió:¿El PIC16F84A no se usaba por los piratillas del Canal Satélite?

Urian escribió:Zokormazo escribió:f5inet escribió:ojo, que no estoy diciendo que XboxONE lleve esto (o al menos, no lo estoy diciendo TODAVIA), simplemente te estoy rebatiendo que ES POSIBLE usar memoria NAND Flash como RAM.

Las Flash son NVRAM, por lo tanto, son RAM.

Otra cosa es poder usarlos como memoria para acumular los datos para poder computarlos. En eso los NAND no son precisamente la mejor eleccion.

Y otra cosa distinta seria usarlo de cache a un nivel alto. En eso, supondra mejorar frente a cualquier memoria mas lenta que ella, como por ejemplo el disco de 5400rpm que monta la consola.

Eso si es un uso viable (si no se esta usando la NAND para nada mas en ese momento) y eficiente.

RAM No Volatil, pero esto no significa que haga la misma función que la memoria RAM.

En ciertos mecanismos donde no es necesario el ancho de banda de la RAM para funcionar, es posible conectar una NAND Flash al procesador y que esta haga de memoria RAM para el mismo.

darksch escribió:¿El PIC16F84A no se usaba por los piratillas del Canal Satélite?

La verdad que programar microcontroladores no es muy entretenido. Para ver el resultado palpable tienes que programarlo físicamente (que es un coñazo) y luego ponerlo en el aparato al que va destinado y ponerlo en marcha.

Prefiero el Z-80 y V9938, es más entretenido y directo

Polyteres escribió:Yo me lo estoy pasando pipa leyéndoos![sonrisa [sonrisa]](/images/smilies/nuevos/risa_ani1.gif)

![sonrisa [sonrisa]](/images/smilies/nuevos/risa_ani1.gif)

.

Un saludo.

Urian escribió:darksch escribió:¿El PIC16F84A no se usaba por los piratillas del Canal Satélite?

La verdad que programar microcontroladores no es muy entretenido. Para ver el resultado palpable tienes que programarlo físicamente (que es un coñazo) y luego ponerlo en el aparato al que va destinado y ponerlo en marcha.

Prefiero el Z-80 y V9938, es más entretenido y directo

No son lo mismo, yo hice un proyecto de pseudo-ordenador de 8 bits con un Z80 y un PIC como coprocesador conectado a una interfaz RF. El PIC se encargaba de ir dibujando en pantalla a la velocidad que haz de electrones recorría la pantalla.

Muy, pero que muy primitivo.

Chifrinillo escribió:Hablemos del interior de los frutos secos

Polyteres escribió:Buenas gente. De verdad sigo sin explicarme el porqué de tanto revuelo, es q estoy flipando en serio![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

![carcajada [carcajad]](/images/smilies/nuevos/risa_ani2.gif)

. Cuantas veces se ha hablado aquí de los 2 command proccessors para gráficos?. Esto parece q es ciclíco. Podríais decirme la diferencia entre la entrevista de los arquitectos de XboxOne en DF y la conferencia HotChip, y esto "nuevo"?. Lo mejor de todo es q no ha cambiado nada desde lo q sabíamos entonces pq no se ha desvelado nada nuevo, se dice exactamente lo mismo.

Por otro lado, estáis confundiendo muchas cosas con respecto a cómo funciona una GPU. Yo me lo estoy pasando pipa leyéndoos![sonrisa [sonrisa]](/images/smilies/nuevos/risa_ani1.gif)

![sonrisa [sonrisa]](/images/smilies/nuevos/risa_ani1.gif)

.

Un saludo.

Chifrinillo escribió:Sería Ud tan amable de explicarnos la verdad sobre el Axi Bridge? En el PDF aparece, por lo que está confirmado.

¿Lo tiene también PS4? ¿Sirve para algo?

isma82 escribió:marjalone escribió:¿Que GPU/APU futura soporta varios contextos graficos independientes?

Todas las GPUS AMD Fusion.

AMD http://developer.amd.com/wordpress/medi ... _final.pdf

- Página 40: Multiple Concurrent Contexts Multiple ACE paths

- pagina 3: Multiple Engine Architecture with Multi-Task Capabilities

- pagina 6: Independent & Concurrent Grid/Group Dispatcher, Background task scheduling, Real time task, scheduling Error Detection & Correction (EDCC), For GDDR and internal SRAM Pools

El paper de AMD sobre GCN.

Szasz escribió:

f5inet escribió:isma82 escribió:[...]

http://developer.amd.com/wordpress/media/2013/06/2620_final.pdf

- Página 40: Multiple Concurrent Contexts Multiple ACE paths

Esta es la tercera vez que lo pongo macho... Una pista ¿Que crees que significa Concurrent? Concurrente es a la vez, Multiples contextos a la vez... vamos no se como quiere que te lo diga AMD. Mas claro es dificil.

[...]

si para ti, CONCURRENTES e INDEPENDIENTES significan lo mismo, obviamente, entenderas que Kaveri y Carrizo son identicos.

El problema es que la realidad es tozuda y las dos palabras son bastante diferentes.

Zokormazo escribió:f5inet escribió:ojo, que no estoy diciendo que XboxONE lleve esto (o al menos, no lo estoy diciendo TODAVIA), simplemente te estoy rebatiendo que ES POSIBLE usar memoria NAND Flash como RAM.

Las Flash son NVRAM, por lo tanto, son RAM.

Otra cosa es poder usarlos como memoria para acumular los datos para poder computarlos. En eso los NAND no son precisamente la mejor eleccion.

Y otra cosa distinta seria usarlo de cache a un nivel alto. En eso, supondra mejorar frente a cualquier memoria mas lenta que ella, como por ejemplo el disco de 5400rpm que monta la consola.

Eso si es un uso viable (si no se esta usando la NAND para nada mas en ese momento) y eficiente.

papatuelo escribió:Zokormazo escribió:f5inet escribió:ojo, que no estoy diciendo que XboxONE lleve esto (o al menos, no lo estoy diciendo TODAVIA), simplemente te estoy rebatiendo que ES POSIBLE usar memoria NAND Flash como RAM.

Las Flash son NVRAM, por lo tanto, son RAM.

Otra cosa es poder usarlos como memoria para acumular los datos para poder computarlos. En eso los NAND no son precisamente la mejor eleccion.

Y otra cosa distinta seria usarlo de cache a un nivel alto. En eso, supondra mejorar frente a cualquier memoria mas lenta que ella, como por ejemplo el disco de 5400rpm que monta la consola.

Eso si es un uso viable (si no se esta usando la NAND para nada mas en ese momento) y eficiente.

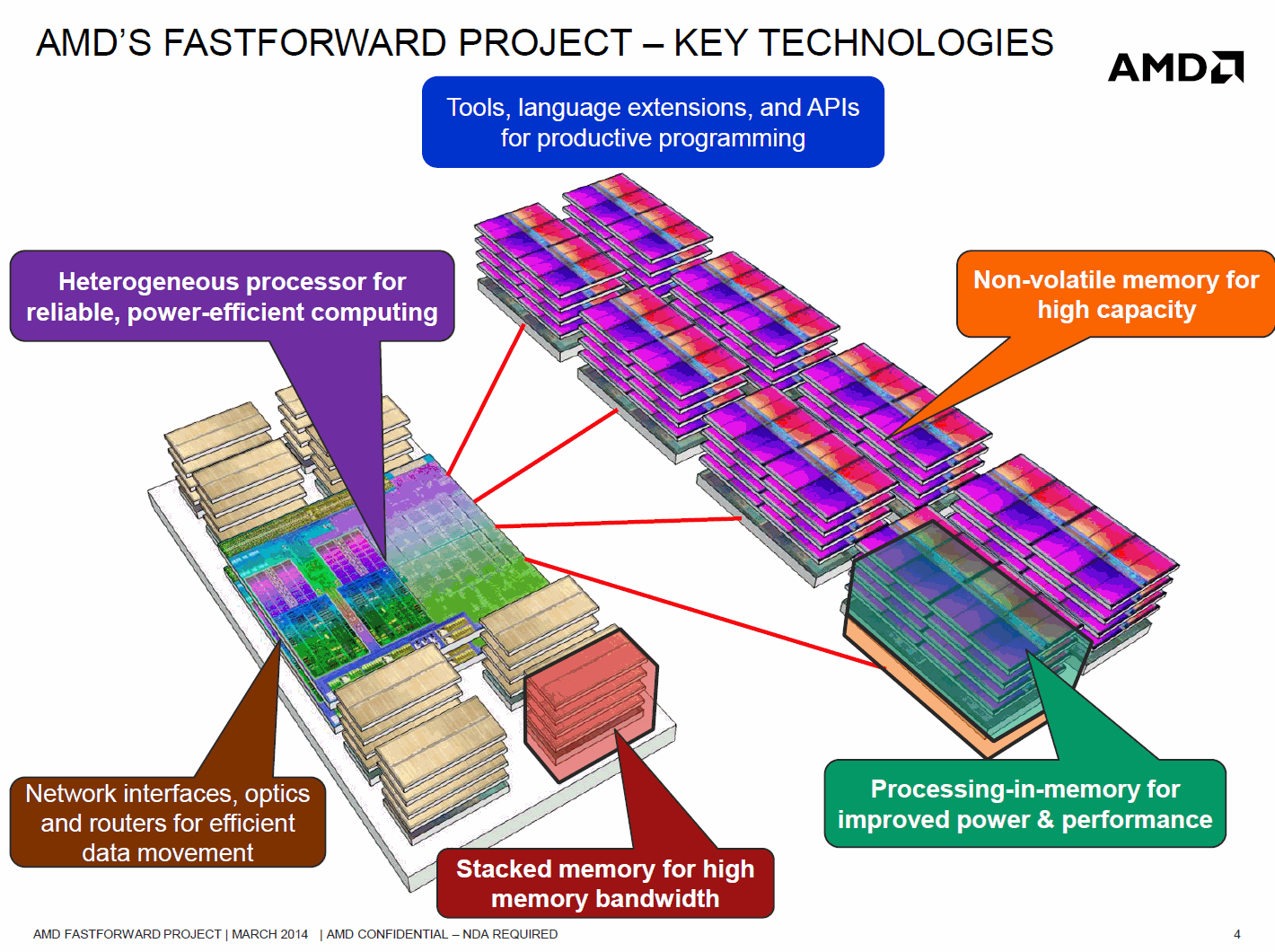

Project Fastforward AMD: PIM en memoria no volatil

isma82 escribió:Independiente es que no depende el uno del otro no que sean simultáneos. En las transparencias de AMD pone claramente Multiple Concurrent Contexts es decir las gpus GCN pueden ejecutar multiples contextos de forma concurrente, lo mismo que dice el paper al que le añade el adjetivo de independientes... ¿Según tu que siginifica que sean independientes? pues que puedes ejecutar ambos contextos simultaneamente sin interferir uno en el otro.

De todas formas, me gustaria que me explicases como encajan en este paper:

- el triple de potencia de cpu de xbox on sobre ps4

- Los anchos de banda de 700 GB/s esram y 250 GB/s ddr3

- Los 35 fpgs

- Los ¿Cuantos procesadores ARM?

- Los 2,6 Tlflops escalabes a 5

¿O ya hemos asumido que eran disparetes? Si pretendes cambiar el sentido del paper para intentar explicar una de las multiples teorias sin sentido ninguno de las que manejas estaría bien una reflexión sobre todas aquellas que deja por los suelos... Y que credibilidad deja esto a esas teorías? Unas son fumadas y otras válidas?

Hay una cosa que esta clara cuando se dicen tonterias obviamente falsas, por muchoa bola que construyas al rededor de ellas acaban saliendo a la luz. ¿Que esperabas? Microsoft lleva auto owneando esas teorias sistemáticamente. Por suerte Microsoft no miente o no suele mentir en sus especificaciones. Cosa que Sony ha hecho muchas veces pero hasta ahora microsoft no. Por eso es complentamente absurdo todo esto y más cuando las diferencias en todo caso son irrisorias. aunque bueno segun algunos xbox one duplica el rendimiento de ps4... esa afirmación es muy facil de demostrar con un juego que vaya al doble de frames por ejemplo o al doble de resolución... Esperando a que suceda estoy.

Dicho lo cual para evitar que se me acuse de nada, porque ya se que palo llevas tu y otros he de decirte que ni tengo ps3, ni tengo ps4 ni me interesa ninguna de las dos consolas y que ahora mismo no me interesa ninguna de las dos, soy usuarios de pc y wii u y no necesito nada más por ahora. Pero que a dia de hoy si tuviese que comprar una consola entre ps4 y xbox one elegiría xbox one porque parto de la magnifica consola que fue y es xbox 360, tengo sagas que me gustan como halo y gears of war, viva piñata o kameo que ojala vuelva y como ochentero que soy tengo en gran estima a la rare que compro microsoft y muchas de sus franquicias... A parte de que es más barata y a dia de hoy tiene mejores juegos. El 20 30 15 o % que sea mejor o peor me la trae al pairo. Y si no la compro es porque el catalogo de juegos exclusivos que no esten en pc es muy pequeño y porque no quiero pagar online que no uso jugando en pc y wii u que está on fire en exclusivos. Explicación que sobraba pero para dejarte claro que no tengo ningún interes en ensuciar el nombre de la consola. Pero lo que no se puede es mentir descaradamente como algunos haceis.

isma82 escribió:Por suerte Microsoft no miente o no suele mentir en sus especificaciones. Cosa que Sony ha hecho muchas veces pero hasta ahora microsoft no. Por eso es complentamente absurdo todo esto y más cuando las diferencias en todo caso son irrisorias. aunque bueno segun algunos xbox one duplica el rendimiento de ps4... esa afirmación es muy facil de demostrar con un juego que vaya al doble de frames por ejemplo o al doble de resolución... Esperando a que suceda estoy.

Pero lo que no se puede es mentir descaradamente como algunos haceis.

isma82 escribió:[...]

- Los 2,6 Tlflops escalabes a 5

[...]

Zokormazo escribió:@papatuelo: En la foto que has posteado, el procesado lo hace en el lado izquierdo, donde estan la RAM y el procesador.

Para que necesitas RAM? para almacenar mil mierdas que leerlas del disco duro cada vez que los necesitaras seria horriblemente lento.

Como procesas algo fuera del SoC sin ningun procesador?

La NAND tiene muchos usos interesantes, pero reemplazar a la memoria (G)DDR no es una de ellas

papatuelo escribió:Zokormazo escribió:@papatuelo: En la foto que has posteado, el procesado lo hace en el lado izquierdo, donde estan la RAM y el procesador.

Para que necesitas RAM? para almacenar mil mierdas que leerlas del disco duro cada vez que los necesitaras seria horriblemente lento.

Como procesas algo fuera del SoC sin ningun procesador?

La NAND tiene muchos usos interesantes, pero reemplazar a la memoria (G)DDR no es una de ellas

Vamos a ver zoco, tienes resalta una zona de la flash con un cartelito que pone procesing in memory (PIM) ¿Cómo lo hacen?Yo que sé, pero la imagen está muy muy clara.

Nuhar escribió:Polyteres escribió:Yo me lo estoy pasando pipa leyéndoos![sonrisa [sonrisa]](/images/smilies/nuevos/risa_ani1.gif)

![sonrisa [sonrisa]](/images/smilies/nuevos/risa_ani1.gif)

.

Un saludo.

Cuidado con las pipas que no seras el primero que se le clava una cascara en el paladar

Entre las pipas, la suegra y el perro no se como te da tiempo a leer todo esto

![por aquí! [poraki]](/images/smilies/nuevos/dedos.gif) . Lo de tiempo para leer todo...lectura en diagonal

. Lo de tiempo para leer todo...lectura en diagonal

.

.f5inet escribió:isma82 escribió:[...]

- Los 2,6 Tlflops escalabes a 5

[...]

ese te lo puedo contestar:

- la APU carrizo tiene 4 instrucciones/juegos de instrucciones adicionales, pero son muy interesantes las siguientes:

* MOVBE: instruccion destinada a mover/transponer datos Bigendian a Littleendian y viceversa. Esto, que parece una patochada, toma sentido cuando se sabe que los procesadores X86 son LittleEndian y los procesadores PowerPC son BigEndian y que en caso de querer hacer un 'emulador' de PPC, se pierde de media un 20% de la potencia en 'transponer' los datos. (retrocompatibilidad en proceso...)

* AVX2: instrucciones dedicadas a operar con los nuevos registros de 256bits, y no de 128bits como hasta ahora. Seran utilizados especificamente para DoublePrecision (vaya, otro leak confirmado...)

Con respecto a la doble precision, con precision simple (GCN 1.x) tenemos registros de 128bits (4*32bits) para floats de 32bits (FP32). tu argumentas que para que queremos precision doble (FP64), si la diferencia entre 0,00000013 y 0,00000013453241 es despreciable... y si, pudiera ser asi... lo que sucede es que en 256bits, en lugar de meter 4*64bits y operar con precision doble, podria meter 8*32 y seguir operando en precision simple, pero realizando EL DOBLE DE TRABAJO (y con este es OTRO LEAK confirmado)

si a eso, le metemos los dos contextos INDEPENDIENTES (que no concurrentes, aunque tambien) que es capaz de manejar la GPU, y que seria una especie de 'hiperthreading' de GPU, tenemos que EL MISMO SILICIO es capaz de rendir entre un 50% y un 100% MAS que la solucion SIN HIPERTHREADING.

Y es por esto que no es lo mismo CONCURRENTE que INDEPENDIENTE. toda la familia GCN ejecutan sus instrucciones en un cola tiene 16 WAVEFRONTS. la ejecucion CONCURRENTE significa que puedes tener hasta 16 WAVEFRONTS esperando la ejecucion, y si UN WAVEFRONT tiene una dependencia de RAM no resuelta (o sea, el bus de RAM esta muy ocupado como para haber traido los datos a la L2 y poder operar con el), puede ejecutar cualquiera de los otros 15 WAVEFRONTS que estan esperando su turno, pero ojo, solo se puede ejecutar un WAVEFRONT si no depende de un WAVEFRONT anterior. es algo que si has estudiado los 'pipes U y V' (como ejemplo de arquitectura superescalar) de la microarquitectura P5 lo entiendes perfectamente http://en.wikipedia.org/wiki/P5_%28microarchitecture%29

La ejecucion de MULTIPLES WAVEFRONTS es lo que permite que si una determinada operacion esta pendiente de una solicitud pendiente no bloquee todo el pipeline de ejecucion. Es a esto cuando se refieren a CONTEXT SWITCH.

El problema es que 'atascar' la GPU con 16 wavefronts que son dependientes unos de otros o estan pendientes de resolucion de RAM es algo que sucede con BASTANTE FRECUENCIA

Los dos contextos INDEPENDIENTES es que, ademas de los 16 wavefronts, puedes tener OTROS 16 Wavefronts esperando en la misma CU. Si, es posbile que aun asi se produzcan atascos, pero no hace falta tener muchas luces para determinar que la probabilidad de atascos con 16 Wavefronts es el doble que con 16+16Wavefronts

al final, ambos leaks estan practicamente confirmados:

- 256bits de GCN2.0 vs 128bits de GCN1.x = 2x rendimiento si se sigue usando la misma precision (FP32)

- 'Hiperthreading' de GPU = 1,5-2x rendimiento que el mismo silicio SIN hiperthreading.

1,31Tflops * 2 * 1,5 = 3,93TFlops

y es por eso por lo que 300 Millones de $ en licenciar una APU jamas podra llegar a los 3000 millones de $ en desarrollar conjuntamente una APU

![Adorando [tadoramo]](/images/smilies/adora.gif)

![Adorando [tadoramo]](/images/smilies/adora.gif)

Zokormazo escribió:papatuelo escribió:Zokormazo escribió:@papatuelo: En la foto que has posteado, el procesado lo hace en el lado izquierdo, donde estan la RAM y el procesador.

Para que necesitas RAM? para almacenar mil mierdas que leerlas del disco duro cada vez que los necesitaras seria horriblemente lento.

Como procesas algo fuera del SoC sin ningun procesador?

La NAND tiene muchos usos interesantes, pero reemplazar a la memoria (G)DDR no es una de ellas

Vamos a ver zoco, tienes resalta una zona de la flash con un cartelito que pone procesing in memory (PIM) ¿Cómo lo hacen?Yo que sé, pero la imagen está muy muy clara.

Tienes razon, no lo habia visto. Te has fijado que curioso que el resto de los 7 bloques del lado izquierdo son iguales, y que ese que menciones de hecho debajo tiene igual, y encima de el, pintado, tiene lo del PIM de una forma un tanto extraña?

Y esto porque? Quizas sea real, pero justo ese cuadrado es el raro... huele raro no crees?

Pero bueno, aun siendo cierto. Ese modulo no esta conectado a la NVRAM, esta conectado al SoC, al igual que el NVRAM.

La razon para usar NVRAM frente a RAMs volatiles tiene que ser la persistencia de datos. En todo lo demas, es tremendamente inferior a otros modelos de RAM

Polyteres escribió:[...]

Sigo esperando q alguien diga q hay de diferente con lo q se vió en la HotChip y/o en la entrevista a los arquitectos de XboxOne hace un año.

Un saludo.

darksch escribió:El MOVE con desplazamiento de bits, no sé si será el mismo MOVBE con otros parámetros u otro, pero en cualquier caso se usaría el mismo hardware para tal fin, puede usarse para cualquier cosa. En realidad se metió más bien para conversión de formatos RGBA y poder intercambiarlos sin necesidad de que lo haga el CS.

We already knew that Carrizo would support AVX2 (presumably with full 256-bit registers as well). We now know that the chip will add support for the BMI2, MOVBE, and RDRAND instructions as well. BMI2 refers to bit manipulation (manipulating code smaller than a word), RDRAND adds support for retrieving a random number from a hardware random number generator implemented on-die, and MOVBE is an Atom instruction (recently added to Haswell) that converts to and from little-endian to big-endian format. Nothing huge here, but it brings AMD up to parity with Haswell save for Intel’s TSX extensions.

pspskulls escribió:Esperando también estamos todos a que en PS4 se vea algo técnico del nivel de los juegos exclusivos mostrados en One, o al menos esa diferencia en resolución y de framerate importante que expliquen el tan llevado 50% more power de PS4. Y espero que no te vayas por las ramas de los primeros multi usando SDK nada optimizados para la máquina. El problema es haber visto un 50% more power en todas partes y de repente los multis actuales son mejores en One (AC Unity, COD AW, GTA5).

Ojo que no te digo que tú hayas defendido el 50% more power. Pero también lo que se ha visto es que NADIE ha defendido que eso no fuera así con tantas ganas como el ataque a la posibilidad de que One ahora gire la tortilla.

darksch escribió:Ahora no encuentro exactamente el artículo donde lo decía. De todas formas el hardware que lo hace es el mismo, el Swizzle Copy, aquí más o menos una referencia de por donde van los tiros:

https://www.google.es/?gws_rd=ssl#q=xbox+one+swizzle+copy+rgb+converter&spell=1

En realidad no es desplazamiento, es la capacidad para intercambiar los bits. La conversión de Endian es un caso particular de esta operación.

isma82 escribió:[...]

@f5inet

1,31Tflops * 2 * 1,5 = 3,93TFlops

Pero no te das cuenta que por cada paper que sale por cada post de MisterXmedia por cada patente que encuentran por ahi cabial es hardware de xbox one 70 veces?

Ahora ya no son 5 tflops ahora son 4? en que quedamos?

No ves que es un desproposito completo. Si tiene ese rendimiento insisto espero ver un multi que tenga 60 fps estables vs 30 fps estables en algún momento. Es así de facil de demostrar. No estas sosteniendo ventajas de 30% arriba que peuden ser diluidas por otros aspectos, no estas planteando una máquina con una diferencia similar entre xbox y ps2, una diferencia como la que hay hoy en pc con respecto a ps4... Es una chaladura muy dificil de sostener, pero me alegra que tengas la osadia de plantearla abiertamente.

Hay una cosa y con esto acabo que argumentas que es de primero de carrera, o de primero de tecnologia de bachillerato, sin querer ofendete... [...]

f5inet escribió:

No ofende el que quiere. ofende el que puede. Y tu no puedes.

punto numero uno: yo no defiendo posturas hilarantes de misterXmedia. yo defiendo MIS POSTURAS. y mis posturas son: ALUs el doble de anchas (256bits de GCN2.0 vs 128bits de GCN1.x) + dos contextos independientes (hiperthreading de GPU) es el equivalente a entre 3 y 4 veces la potencia inicial (dependiendo del margen que le quieras dar al hiperthreading de GPU, 1,5-2x)

punto numero dos: es mi opinion, y las opiniones son como los culos: todo el mundo tiene uno y cree que el de los demas apesta

punto numero tres: ya que has sacado el tema... ¿Forza Horizon 2 vs DriveClub no te vale como ejemplo de diferencia de potencia entre una y otra? al fin y al cabo, son los dos unicos exclusivos de coches, y la salida fue mas o menos por las mismas fechas...

isma82 escribió:[...]Lo que vienes a decir tu es que xbox one es sumamente más potente que ps4... y te basas en.... nada, porque los documentos de microsoft no lo dicen, los juegos no lo demuestran y los desarrolladores no lo suscriben... pues chico, que quieres que te diga... pues que tu por decir puedes decir las chorradas que quieras pero seguirán siendo eso, chorradas y vendida de humo. Golpecitos en el pecho para autoconvencerte de no se muy bien el que pero bueno... Solo me queda decir que disfrutes de la potencia oculta... que ya cuando salga me avisas

f5inet escribió:isma82 escribió:[...]Lo que vienes a decir tu es que xbox one es sumamente más potente que ps4... y te basas en.... nada, porque los documentos de microsoft no lo dicen, los juegos no lo demuestran y los desarrolladores no lo suscriben... pues chico, que quieres que te diga... pues que tu por decir puedes decir las chorradas que quieras pero seguirán siendo eso, chorradas y vendida de humo. Golpecitos en el pecho para autoconvencerte de no se muy bien el que pero bueno... Solo me queda decir que disfrutes de la potencia oculta... que ya cuando salga me avisas

No. Eso lo has dicho tu. yo no he metido a PS4 en el saco hasta que tu la has metido. Lo que defiendo es que XboxONE es mucho mas potente que lo que los frios numeros de 1,31Tflops dicen... al igual que los 240Gflops de la GPU de Xbox360 no representaban la potencia real de la consola, que estuvo en paridad durante toda la generacion contra los 1,8Tflops del RSX de PS3 (sisi, he escrito bien, 1,8Tflops de la GPU de PS3. http://www.ign.com/articles/2005/05/16/ ... ch-specs-2 )

f5inet escribió:Polyteres escribió:[...]

Sigo esperando q alguien diga q hay de diferente con lo q se vió en la HotChip y/o en la entrevista a los arquitectos de XboxOne hace un año.

Un saludo.

Esta es la diferencia: http://www.computer.org/csdl/mags/mi/pr ... 756701.pdf

One thing to keep in mind when looking at comparative game resolutions is that currently the Xbox One has a conservative 10 per cent time-sliced reservation on the GPU for system processing. This is used both for the GPGPU processing for Kinect and for the rendering of concurrent system content such as snap mode. The current reservation provides strong isolation between the title and the system and simplifies game development (strong isolation means that the system workloads, which are variable, won't perturb the performance of the game rendering). In the future, we plan to open up more options to developers to access this GPU reservation time while maintaining full system functionality.

To facilitate this, in addition to asynchronous compute queues, the Xbox One hardware supports two concurrent render pipes. The two render pipes can allow the hardware to render title content at high priority while concurrently rendering system content at low priority. The GPU hardware scheduler is designed to maximise throughput and automatically fills "holes" in the high-priority processing. This can allow the system rendering to make use of the ROPs for fill, for example, while the title is simultaneously doing synchronous compute operations on the Compute Units.

isma82 escribió:f5inet escribió:isma82 escribió:[...]Lo que vienes a decir tu es que xbox one es sumamente más potente que ps4... y te basas en.... nada, porque los documentos de microsoft no lo dicen, los juegos no lo demuestran y los desarrolladores no lo suscriben... pues chico, que quieres que te diga... pues que tu por decir puedes decir las chorradas que quieras pero seguirán siendo eso, chorradas y vendida de humo. Golpecitos en el pecho para autoconvencerte de no se muy bien el que pero bueno... Solo me queda decir que disfrutes de la potencia oculta... que ya cuando salga me avisas

No. Eso lo has dicho tu. yo no he metido a PS4 en el saco hasta que tu la has metido. Lo que defiendo es que XboxONE es mucho mas potente que lo que los frios numeros de 1,31Tflops dicen... al igual que los 240Gflops de la GPU de Xbox360 no representaban la potencia real de la consola, que estuvo en paridad durante toda la generacion contra los 1,8Tflops del RSX de PS3 (sisi, he escrito bien, 1,8Tflops de la GPU de PS3. http://www.ign.com/articles/2005/05/16/ ... ch-specs-2 )

Se perfectamente las chorradas que Sony dijo en su momento y las mentiras que soltó. No hagas tu lo mismo. Tenga algo más de clase. Si tu dices que xbox tiene 4 tflops estas diciendo que tiene mas el doble de rendimiento que ps4. Directa o indirectamente lo estas diciendo. Y no solo eso si no que tiene mas rendimiento que muchos pcs que ahora mismo defenestran en rendimiento a las dos consolas. Ya te digo que pobre jaguar lo que va a sufrir para darla de comer. Los 240a Gflosp de xbox 360 representaba la potencia real de la consola que era en gpu un 30% o 40% superior a la de ps3. A la potencia real de la ps3 no la la inventada por Sony.

f5inet escribió:

¿No me digas que hemos pasado a no creer en fuentes primarias? https://www.youtube.com/watch?v=OtZ-rK349aY#t=804

no es justo que por un lado me pidas que ignore fuentes primarias, y que por el otro me acuses que no tengo fuentes primarias.

¿No me digas que hemos pasado a no creer en fuentes primarias? https://www.youtube.com/watch?v=OtZ-rK349aY#t=804

no es justo que por un lado me pidas que ignore fuentes primarias, y que por el otro me acuses que no tengo fuentes primarias.

El problema es haber visto un 50% more power en todas partes y de repente los multis actuales son mejores en One (AC Unity, COD AW, GTA5).

isma82 escribió:[...]Es justo lo que estais haciendo vosotros ahora.[...]

Cyborg_Ninja escribió:

¿No me digas que hemos pasado a no creer en fuentes primarias? https://www.youtube.com/watch?v=OtZ-rK349aY#t=804

no es justo que por un lado me pidas que ignore fuentes primarias, y que por el otro me acuses que no tengo fuentes primarias.

No, si Sony dira misa, pero ni la GPU, ni el sistema completo de PS3, tenian ni por asomo 1,8 Teraflops, es mas, en Flops la GPU de la 360 llevaba la ventaja. Rondaban los 200 GF en ambos casos.

Creo que isma82 es el que esta dando en el clavo, mas que el amigo Polysteres, que aunque tiene sus preferencias y se nota, esta siendo bastante mas realista que algunos con los 4 Teraflops.El problema es haber visto un 50% more power en todas partes y de repente los multis actuales son mejores en One (AC Unity, COD AW, GTA5).

Como? Unity es el unico de los que citas que puede ser mejor en one, COD: AW tiene mejor framerate en One pero menor resolucion (1360x1080p con subidas a 1920x1080p vs 1920x1080p constantes), y GTA V es directamente peor en One porque tiene algun efecto reducido y menos densidad de follaje.

Y gtaV en ps4 es un despropósito contínuo de niebla. Antes la nítidez de One que ver 4 hierbas bien cerca y el resto como el culo.

f5inet escribió:isma82 escribió:[...]Es justo lo que estais haciendo vosotros ahora.[...]

perdona, me acabo de perder... ¿quien es 'vosotros'?