kai_dranzer20 escribió:Simplemente porque las maquinas no piensan, por mas IA que les pongan, no harán mas cosas que para las que las programe una persona.

Un experto prevé la elaboración de leyes especiales para regular los 'derechos' de los robots .

-Los expertos en inteligencia artificial se reúnen en estos días en Barcelona.

-Algunos de ellos subrayan la necesidad de que los avances en el mundo de la robots vayan acompañados de una legislación que los dote de "derechos".

En unos años, la presencia de robots domésticos dotados de un alto grado de inteligencia artificial será habitual en las casas de los más acomodados y obligarán a plantearse la necesidad de una legislación específica para estos nuevos "seres" autónomos. Así lo ha subrayado este martes el director del Instituto de Investigación en Inteligencia Artificial (IIIA-CSIC), Ramón López de Mantaras, en el marco de la International Joint Conference Artificial Intelligence que se celebra en Barcelona.

Si quieres twittear esta noticia #robots.

López de Mantaras ha explicado que frente al rápido avance de la robótica -cada vez más autónomos y con mayor capacidad de decisión- hay expertos en derecho y tecnología, sobre todo en EE UU, que defienden que se les dote también de ciertos "derechos".

Si son muy autónomos, quién será responsable de las decisiones de los robots, ¿el propio robot, los diseñadores o el usuario? Para este experto en razonamiento y aprendizaje, si a medio o largo plazo se desarrollan robots socializados con inteligencias artificiales similares a la del hombre, con quienes convivirá en sus casas o a los que atenderán en las tiendas, "no resultaría descabellado", legislar sobre sus responsabilidades y derechos. "Si son muy autónomos, quién será responsable de las decisiones de los robots, ¿el propio robot, los diseñadores o el usuario? porque ellos aprenderán del usuario, vendrán con un mínimo de preparación, pero luego irán desarrollándose. No tengo respuestas", reconoce.

En esta línea, advierte del riesgo de utilizar la inteligencia artificial para el desarrollo de robots militares, una tecnología sobre la que hay un gran mutismo en el ámbito científico. A juicio de este científico es inaceptable desde el punto de vista ético utilizar la inteligencia artificial para construir un robot soldado con autonomía para decidir cuándo disparar o cuándo no. "Eso es algo que hay que cortar de raíz", reclama.

La integración en un único sistema de las diferentes capacidades de la inteligencia artificial -reconocimiento de voz, movimiento o visión entre otras- para favorecer una mejor interacción entre hombre y máquina es en estos momentos el principal reto de este ámbito, y uno de los ejes de la conferencia internacional que se celebra en Barcelona hasta el viernes, con la presencia de 1.400 expertos.

fuente: 20minutos.es

kai_dranzer20 escribió:...nunca sucederá esa tontería de que las maquinas dominarán el mundo o se revelarán ante la humanidad.

...no harán mas cosas que para las que las programe una persona...

Bilkoff escribió:Espero poder ver algún día en mi casa una panda de autómatas que me traigan el desayuno a la cama

Bilkoff escribió:kai_dranzer20 escribió:...nunca sucederá esa tontería de que las maquinas dominarán el mundo o se revelarán ante la humanidad.

...no harán mas cosas que para las que las programe una persona...

Hay mucho pillao por ahí, y algunos saben programar bastante bien.

![como la niña del exorcista [360º]](/images/smilies/nuevos/vueltas.gif)

kai_dranzer20 escribió:Antes de que salga alguien o un Terminator-fan, solo para decir y asegurarles, que nunca sucederá esa tontería de que las maquinas dominarán el mundo o se revelarán ante la humanidad.

Simplemente porque las maquinas no piensan, por mas IA que les pongan, no harán mas cosas que para las que las programe una persona. Pensar lo contrario, es mostrar que no se tiene suficiente sentido común.

Respecto a la noticia, que bien que avance la robótica para servir mejor en las catástrofes.

kai_dranzer20 escribió:Antes de que salga alguien o un Terminator-fan, solo para decir y asegurarles, que nunca sucederá esa tontería de que las maquinas dominarán el mundo o se revelarán ante la humanidad.

Simplemente porque las maquinas no piensan, por mas IA que les pongan, no harán mas cosas que para las que las programe una persona. Pensar lo contrario, es mostrar que no se tiene suficiente sentido común.

Respecto a la noticia, que bien que avance la robótica para servir mejor en las catástrofes.

kai_dranzer20 escribió:Simplemente porque las maquinas no piensan, por mas IA que les pongan, no harán mas cosas que para las que las programe una persona. Pensar lo contrario, es mostrar que no se tiene suficiente sentido común.

Deen0X escribió:Mientras puedas definir que es la inteligencia, entonces se puede "programar".

Todavía estamos en debate sobre si los animales son inteligentes o no (un animal piensa o solo actúa por instinto?)..

Si quieren tener exito en robotica, tienen que hacer Dolls muy realistas, mujeres que te hagan la comida, limpien y lo que ya sabemos robots. Imaginaos como se vendería eso, dios

![enrojecido [ayay]](/images/smilies/nuevos/sonrojado_ani1.gif)

![enamorado [amor]](/images/smilies/nuevos/enamorado.gif)

![loco [looco]](/images/smilies/nuevos2/borracho.gif)

![demoniaco [sati]](/images/smilies/nuevos2/demonio.gif)

neowar3020 escribió:programar: revelarse ante la humanidad.

kai_dranzer20 escribió:Como seguidor del grupo Elron, estoy convencido de lo que digo; así que un robot, jamás podrá imaginar, soñar o tener sentimientos, ni mucho menos que tenga pensamientos abstractos, aun por más algoritmos que se puedan programar, por lo tanto un robot nunca podrá pensar. Que no dudo que habrá robots impresionantes, pero ninguno de nosotros vivirá como John Connor ni nadie por estilo

![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif) )

)![por aquí! [poraki]](/images/smilies/nuevos/dedos.gif)

Como seguidor del grupo Elron, estoy convencido de lo que digo

Estwald escribió:Bueno, tengo que decir que no estoy de acuerdo con alguna de las cosas que dices:

Imaginar: proceso por el cual un robot establece los pasos que debe dar para realizar su tarea, antes de hacerla.

Soñar: obviamente, si no duerme, no tiene por que soñar, pero si en estado de reposo (equivalente a dormir) un robot utilizara su capacidad de imaginar para aprender mediante simulación mejores formas de realizar su tarea, se podría decir que hace una función parecida.

Tener sentimientos: eso es posible en un robot con cierta capacidad de evaluación y al que se le programen ciertas respuestas. Por ejemplo, un robot podría sentir "dolor" cuando se está dañando, podría sentir "miedo" ante una situación de peligro y ese miedo optimizaría su programación para por ejemplo, evitar que su dueño sufra daño ante un peligro o el mismo. Podría sentir "frustración" ante la dificultad de resolver un problema y eso sería un mecanismo para dedicar nuevos circuitos a su resolución, por ejemplo. Y así con todo (por ejemplo, se podría "enfadar" si un niño le tira piedras y el acto sería reprenderle por la acción)

Todo depende de la complejidad y el tipo de programación que tenga, pero los equivalentes se podrían implementar.

Sobre los pensamientos abstractos, pues depende de que definas como pensamientos abstractos, pero ten en cuenta una cosa: el problema no está en el robot, que no tenga capacidad para hacer tal o cual cosa, si no en el humano que no sabe o es capaz de implementar los programas necesarios para poder simular ese tipo de respuestas. Y luego está que a nosotros nos interese mas o menos, programarles ciertas respuestas (por ejemplo, no nos interesa un robot que deje de obedecer a su dueño, solo por que le desagrada la forma en que le habla)

Eso si, en mi opinión, lo mejor es que nos dediquemos a hacer robots que cumplan tareas propias de máquinas autónomas inteligentes y no porno chachas de metal que imitan a las humanas

Lo que comentas es un poco el resumen de esas propuestas y dudas que se generan en muchos eventos sobre IA y Robótica.

Lo que comentas es un poco el resumen de esas propuestas y dudas que se generan en muchos eventos sobre IA y Robótica.kai_dranzer20 escribió:

Como seguidor del grupo Elron, estoy convencido de lo que digo; así que un robot, jamás podrá imaginar, soñar o tener sentimientos, ni mucho menos que tenga pensamientos abstractos, aun por más algoritmos que se puedan programar, por lo tanto un robot nunca podrá pensar. Que no dudo que habrá robots impresionantes, pero ninguno de nosotros vivirá como John Connor ni nadie por estilo

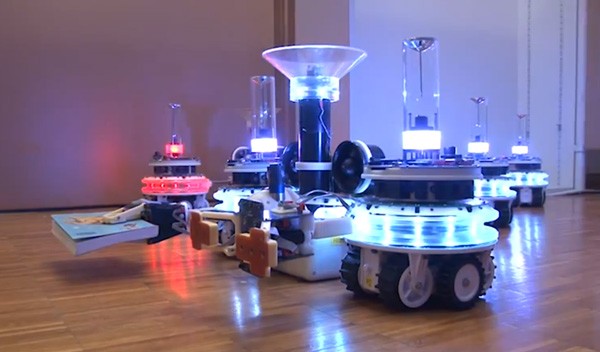

dnL7up escribió:Pues la verdad a mi me parece una versión moderna de la «Máquina de Rube Goldberg»

![Aplausos [plas]](/images/smilies/aplauso.gif)

![Nop [noop]](/images/smilies/net_thumbsdown.gif)

kai_dranzer20 escribió:Es una verdadera lástima la gente que desperdicia su vida en la robótica

kai_dranzer20 escribió:Calma, no lo dije por molestar, es una forma de decir que les falta por descubrir, específicamente en el campo de la IA, algo muy importante, como dije antes, lo que es realmente la Inteligencia. Sin ese conocimiento, no se avanzará mucho.