uchi23a escribió:@Pollonidas

se que suele ser fiable esa paguina, pero solo 4.7 % de mejora

En borderlands 3?

Creo que se han traspapelado los números o han usado el 5600 ya que este juego se ah compilado casi exclusivamente para usar la 3D caché donde mínimo le saca 50fps de mejora en fhd ( a mayor resolución ya no tanto.

Sin cenceramente no me creo nada de esa tabla, si dijeran que es el 5800x normal entonces si.

@virtus tocará espera, ahora sí es tu único pc principal es un putadon para encontrar otro Intel ya que vendiendo placa perderás pasta... Puedes probar por anunciarla a ver qué te dicen

@Necrofero pero sera un parche mediante actualización de BIOS como paso en los 9900k... (Capandolos un poco

La diferencia del 5% a favor de AMD en 1080p es coherente con otras fuentes, como por ejemplo:

El 5600 es muy inferior también en Borderlands 3 a las gamas altas de intel, y el 5800x también, no tiene sentido alguno lo que comentas de que hayan mezclado datos. Y si bien no llega a la cantidad (ni velocidad) de las alternativas de AMD los procesadores de gama alta de intel no van justos de caché L3 precisamente, por lo que tiene todo el sentido del mundo que, si el juego está optimizado para 3Dcaché, también escale bien cuando la caché aumenta en otra arquitectura.

...el que sí saca una ventaja sustancial es el 7800X3D. Pero creo que aquí nadie está dudando que ese es el procesador por excelencia para juegos ahora mismo, tanto en los que escalan bien con caché como para los que no.

virtus escribió:@uchi23a Si, creo que la opción más sensata es esperar y según noticias o acontecimientos escoger.

De buena gana vendía placa , memorias y me piraba amd que a dia de hoy parece más estable y con menos problemas.

Por la placa no creo que me den más de 120 y las memorias ddr4 60 como mucho ya que pillaría unas ddr5.

Opciones todas ,ya depende cómo habéis dicho de cada uno .

En caso de montar nuevo quizás, pero yo teniendo lo que tienes creo que es mucho dinero a invertir para no ganar apenas nada. De hecho salvo que pongas muchos billetes pierdes bastante en multihilo.

En esta historia uno no sabe ya a quién creer porque hay muchos intereses y vete a saber si se mueve dinero para "salvar los trastos", pero creo que ya se ha mencionado en el tema que hace poco que Puget Systems (probablemente "la" referencia en tests de rendimiento en equipos de diseño) publicó un

artículo bastante extenso en el que no se veían grandes diferencias en fiabilidad entre los "rojos" y los "azules". En caso de buscar diferencias al milímetro, fallan más los AMD recientes. La compañía como tal no debería tener especial interés en falsear nada ya que montan equipos con ambos fabricantes, y de hecho en sockets de servidor con abrumadora mayoría de AMD.

Sí que hay una generación problemática de intel, pero no es ni la 13ª ni la 14ª, es la 11ª.

De todas formas incluso viendo esos datos yo tengo algunas cuestiones sobre degradación a largo plazo que siguen en el aire. Y PS usa sus propios ajustes de energía y desactiva MCE desde hace tiempo según dicen en el propio artículo, lo cual ayuda al menos a no "echar más leña al fuego".

Pero si el problema es el voltaje de CPU...

AMD está usando valores similares. En intel hay transitorios de casi 1.6V pero esos solo se ven en un osciloscopio, pero es que de AMD no he visto a nadie (de hecho, es que si no es buildzoid, dudo que ningún otro sitio se "anime") que haga una comparación similar al respecto y no creo que sean mucho más bajos.

edito:

@PSX22 disculpa, creo que me había dejado lo siguiente sin contestar:

PSX22 escribió:En cuanto a la cuestion que me has estado ayudando sobre MCEl, gracias lo tengo mucho mas claro, si actualizo la bios no me afectaria porque usaria los mismos parametros y el microcode ese , es para generaciones posteriores, me rendiria lo mismo. quieres decir que los valores default seran mas sensatos, pero si uso MCE no me va a variar , o eso he entendido. lo tengo en 150w y pl2 250 ( nunca llega jugando ni editando maximo 180 editando y no pasa de 80) tengo entendido que el PL2 es para picos de consumo en la escala de microsegundos, eso no puede recalentar, y PL1 150, nunca llega jugando a mas de 100w, estoy tranquilo por esa parte.

si el mce solo me da mejor boost en 2 cores, todos mis juegos usan mas de 2 cores, entonces nunca tengo esa ventaja jugando?? o es que 2 cores si que suben, y el resto va a la velocidad maxima sin turbo?

yo creo que tu bajas PL porque tendras una CPU que ya limitada tiene mucho IPC y potencia, porque yo tengo comprobado que si uso 65TDP , me da menos fps el juego, pero seguro seguro. Es mas eficiente si, pero realmente que me vaya a 50grados o a 60 grados a mi me da igual y si que me da mas fps y los lows no son tan lows.

Realmente hay más límites de potencia que PL1 y PL2, los que son para escalas de microsegundos son PL3 y PL4, que no suelen ser visibles al usuario en la mayoría de las placas base (y tampoco tiene sentido que lo fueran porque en la mayoría de casos vienen desactivados o muy "suaves").

PL1 es indefinido, PL2 es para escalas de decenas de segundos (donde el limtiante puede ser la capacidad de disipación de la refrigeración a largo plazo, lo que aguantan las fases, o la degradación por temperatura). Lo del TDP nunca ha estado muy claro, pero se supone que es el consumo mantenido en una carga elevada pero

realista. El PL1 puede ser más alto que el TDP por eso, porque el consumo del procesador calculando primos de Mersenne seguramente sea más alto de lo que se espera que la refrigeración tenga que disipar en condiciones "normales" (por ejemplo, jugando a un juego exigente).

A lo que "ataca" la última actualización de microcódigo es justamente a los picos (transitorios) que deberían mitigar PL3 y PL4. No debería afectar apenas al rendimiento ni a los FPS mínimos porque son periodos muy cortos, pero seguramente mirando con lupa todo cuenta, claro. Pero personalmente lo mismo me da que los mínimos sean de 64.9fps o de 64.2, que quizás sería la diferencia de la que estamos hablando.

Sobre lo que mencionas del uso de núcleos y MCE si te he entendido bien es al contrario, sin MCE es cuando las frecuencias de boost más altas se alcanzan solo en los dos "mejores" núcleos (mejores en el sentido de que han salido más "perfectos" de la fábrica y aguantan mayores frecuencias a menor voltaje sin fallar), y solo cuando hay

pocos núcleos en uso (hay que matizar lo de "pocos", porque mucha gente asume que "pocos" significa "menos de dos" y no necesariamente, el limitante suele ser la temperatura y el consumo, y nada impide que con 6+ núcleos en uso ligero 2 de ellos estén a frecuencia elevada).

Lo que hace activar MCE es decir "bueno, la frecuencia que normalmente está reservada solo para los dos mejores núcleos, la usamos para todos independientemente del consumo extra". Lógicamente eso se traduce en más rendimiento, pero implica 1) Subir el voltaje para que los núcleos "malos" también sean estables a esa frecuencia 2) Aumentar drásticamente los límites de consumo para que esas frecuencias se puedan alcanzar.

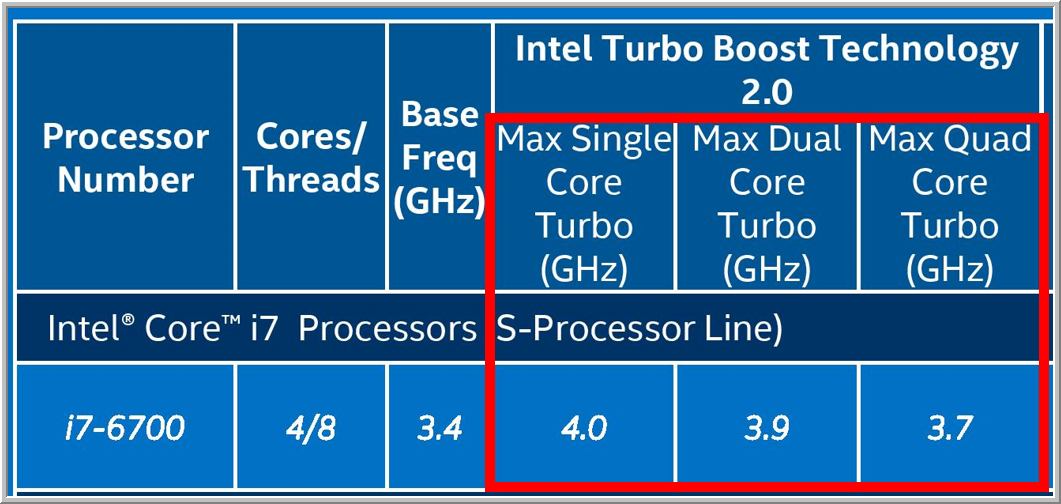

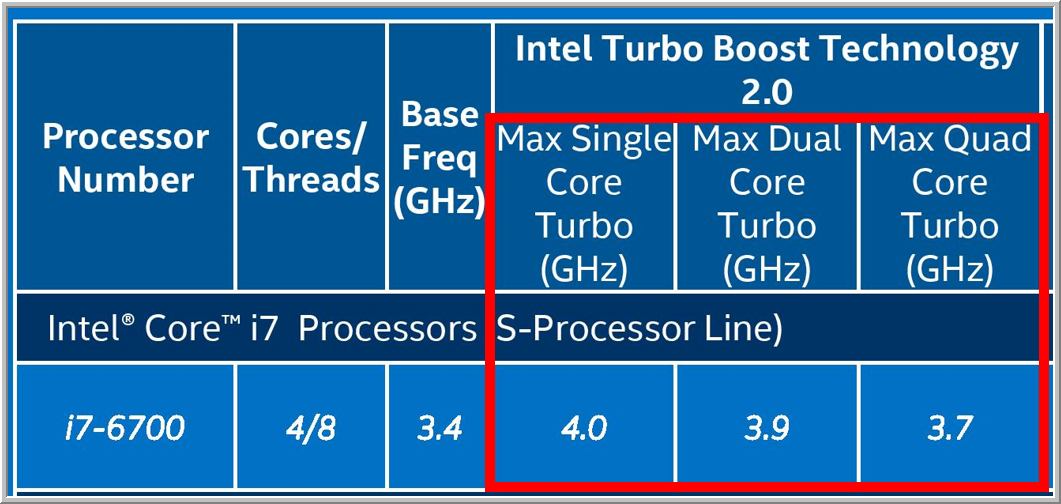

Incluso con MCE desactivado, el resto de núcleos no pierden la frecuencia de turbo ni mucho menos, suelen ser 1-2 puntos del multiplicador de diferencia (100-200mhz a la baja). En generaciones pasadas Intel documentaba de forma explícita la frecuencia de turbo según el número de núcleos usados, recientemente, que yo sepa, no lo hace (depende de muchas variables y no se quieren pillar los dedos). Un ejemplo:

En el caso anterior la frecuencia sin turbo son 3.4Ghz, por lo que como ves incluso con todo de estricto stock se queda bastante por encima y los mínimos no deberían empeorar significativamente. Con MCE lo que pasaría es que el procesador mantendría un boost a 4.0Ghz independientemente del número de núcleos en uso y de la carga. Eso era el "modus operandi" común de todas las placas base, cosa que era bastante razonable ya que con "solo" 4 núcleos y procesadores un poco menos "apretados" no había mayores contraindicaciones (aparte de perder eficiencia) para hacer eso. Ahora mismo... a mí me parece un error. Sobre todo que venga activado de fábrica, eso es de juzgado de guardia. Pero a ver quién iba a ser el primer fabricante de placas base que, si no hubiera pasado lo que ha pasado,

empeoraría sus benchmarks deliberadamente por hacer las cosas

bien. Con las consiguientes ventas perdidas y reviews negativas, claro.

Saludos

![por aquí! [poraki]](/images/smilies/nuevos/dedos.gif)

![loco [looco]](/images/smilies/nuevos2/borracho.gif)

![ok [ok]](/images/smilies/nuevos2/okis.gif) 👍👍👍

👍👍👍 ![loco [looco]](/images/smilies/nuevos2/borracho.gif)

![bomba [boma]](/images/smilies/nuevos2/bomba.gif)

se que suele ser fiable esa paguina, pero solo 4.7 % de mejora

se que suele ser fiable esa paguina, pero solo 4.7 % de mejorase que suele ser fiable esa paguina, pero solo 4.7 % de mejora