f5inet escribió:ForzaThor escribió:f5inet , da gusto leerte, porque hasta un ignorante en estos temas como yo te entiende. Pero hay algo que llama mi curiosidad de absoluto desconocedor de estos temas.....si al final el resultado de una y otra consola van a ser parecidos ¿no es una perdida de tiempo desarrollar herramientas como dx12 (supongo que esto lleva una currada de la leche), hardware especifico para algunas tareas y demas cosas, si la otra al final va a tener los mismos resultados sin tantas vueltas?Para responder a eso deberiamos empezar a hablar de temas politicos y hacer unos pocos de brindis al sol, ya que no tengo el delorean por casa para saber el futuro, pero hablemos de ello.

La principal, y deberia decir PRINCIPAL (asi, en mayusculas) razon de Microsoft para meter DDR3 (en lugar de GDDR5, que dicho sea de paso, hubiese sido lo logico, ya que Xbox360 usaba GDDR3) fue que en Epic pidieron 8GB de RAM y un rendimiento de 2,5 TeraFlops para mover el Unreal Engine 4 a 1080p (o 1,1TF a 720p, o si querias mantener 1080p y le quitaban la iluminacion por Voxeles y usaban un modelo de iluminacion mas modesto, como el Cone-lighting, podrias correrlo con 1,4TF. Si, la iluminacion por voxeles se come ella solita 1TeraFlop de proceso).

Los 2,5TF eran inalcanzables para cualquier sistema sub-600$, asi que fue directamente descartado. En su lugar se penso un sistema de 1,2TF, potencia suficiente para ejecutar UE4 a 720p y se contaria con la ayuda de la computacion en la nube para calcular la iluminacion. En ese caso, un juego basado en UE4 correria a 720p si se ejecutase offline, y a 1080p si podia usar computacion en nube.

Con respecto a los 8GB, los unicos modulos con los que conseguir mantener los costes bajo control, y conseguir un precio target de 500$ era la DDR3. Nadie, ni siquiera Samsung o Hinix (los mayores fabricantes mundiales de GDDR5) preveian fabricar modulos de 4Gbits a coste competitivo en la fecha de lanzamiento de la next-gen. Apostar por GDDR5 era demasiado arriesgado, y los fabricantes solo podian garantizar modulos de 2Gbit. Cabe aclarar que por temas electronicos, colocar mas de 16 chips de RAM es una apuesta MUY arriesgada. Montar modulos de 2Gbit (256MB por chip) habria supuesto colocar 32 de esos chips para conseguir 8GB, ¡Una solucion ARRIESGADISIMA!. Optar por la via de GDDR5 podria haber supuesto un precio de venta en la fecha de lanzamiento de mas de 800$ si se queria montar 8GB de GDDR5. La unica apuesta segura para un PVP objetivo de 500$ (e incluso de 400$, similar al precio de lanzamiento de X360) era usar DDR3.

Una vez que tenemos la potencia (1,2TF) y la RAM (8GB DDR3) hay que ponerse a desarrollar tecnologias para que eso no se atasque, y ahi si quehan dado el DO de pecho en MS. Han creado la mejor arquitectura con las armas de las que disponian. Han invertido mas de 3.000 millones con AMD trabajando codo con codo para desarrollar soluciones a los problemas, y han creado una consola 'preparada para el futuro'.

¿Se han equivocado? Eso solo el tiempo lo dira. De momento, sobre el papel, la apuesta es buena.

![enamorado [amor]](/images/smilies/nuevos/enamorado.gif)

f5inet escribió:ForzaThor escribió:f5inet , da gusto leerte, porque hasta un ignorante en estos temas como yo te entiende. Pero hay algo que llama mi curiosidad de absoluto desconocedor de estos temas.....si al final el resultado de una y otra consola van a ser parecidos ¿no es una perdida de tiempo desarrollar herramientas como dx12 (supongo que esto lleva una currada de la leche), hardware especifico para algunas tareas y demas cosas, si la otra al final va a tener los mismos resultados sin tantas vueltas?

Para responder a eso deberiamos empezar a hablar de temas politicos y hacer unos pocos de brindis al sol, ya que no tengo el delorean por casa para saber el futuro, pero hablemos de ello.

La principal, y deberia decir PRINCIPAL (asi, en mayusculas) razon de Microsoft para meter DDR3 (en lugar de GDDR5, que dicho sea de paso, hubiese sido lo logico, ya que Xbox360 usaba GDDR3) fue que en Epic pidieron 8GB de RAM y un rendimiento de 2,5 TeraFlops para mover el Unreal Engine 4 a 1080p (o 1,1TF a 720p, o si querias mantener 1080p y le quitaban la iluminacion por Voxeles y usaban un modelo de iluminacion mas modesto, como el Cone-lighting, podrias correrlo con 1,4TF. Si, la iluminacion por voxeles se come ella solita 1TeraFlop de proceso).

Los 2,5TF eran inalcanzables para cualquier sistema sub-600$, asi que fue directamente descartado. En su lugar se penso un sistema de 1,2TF, potencia suficiente para ejecutar UE4 a 720p y se contaria con la ayuda de la computacion en la nube para calcular la iluminacion. En ese caso, un juego basado en UE4 correria a 720p si se ejecutase offline, y a 1080p si podia usar computacion en nube.

Con respecto a los 8GB, los unicos modulos con los que conseguir mantener los costes bajo control, y conseguir un precio target de 500$ era la DDR3. Nadie, ni siquiera Samsung o Hinix (los mayores fabricantes mundiales de GDDR5) preveian fabricar modulos de 4Gbits a coste competitivo en la fecha de lanzamiento de la next-gen. Apostar por GDDR5 era demasiado arriesgado, y los fabricantes solo podian garantizar modulos de 2Gbit. Cabe aclarar que por temas electronicos, colocar mas de 16 chips de RAM es una apuesta MUY arriesgada. Montar modulos de 2Gbit (256MB por chip) habria supuesto colocar 32 de esos chips para conseguir 8GB, ¡Una solucion ARRIESGADISIMA!. Optar por la via de GDDR5 podria haber supuesto un precio de venta en la fecha de lanzamiento de mas de 800$ si se queria montar 8GB de GDDR5. La unica apuesta segura para un PVP objetivo de 500$ (e incluso de 400$, similar al precio de lanzamiento de X360) era usar DDR3.

Una vez que tenemos la potencia (1,2TF) y la RAM (8GB DDR3) hay que ponerse a desarrollar tecnologias para que eso no se atasque, y ahi si quehan dado el DO de pecho en MS. Han creado la mejor arquitectura con las armas de las que disponian. Han invertido mas de 3.000 millones con AMD trabajando codo con codo para desarrollar soluciones a los problemas, y han creado una consola 'preparada para el futuro'.

¿Se han equivocado? Eso solo el tiempo lo dira. De momento, sobre el papel, la apuesta es buena.

Strife 117 escribió:f5inet escribió:ForzaThor escribió:f5inet , da gusto leerte, porque hasta un ignorante en estos temas como yo te entiende. Pero hay algo que llama mi curiosidad de absoluto desconocedor de estos temas.....si al final el resultado de una y otra consola van a ser parecidos ¿no es una perdida de tiempo desarrollar herramientas como dx12 (supongo que esto lleva una currada de la leche), hardware especifico para algunas tareas y demas cosas, si la otra al final va a tener los mismos resultados sin tantas vueltas?

Para responder a eso deberiamos empezar a hablar de temas politicos y hacer unos pocos de brindis al sol, ya que no tengo el delorean por casa para saber el futuro, pero hablemos de ello.

La principal, y deberia decir PRINCIPAL (asi, en mayusculas) razon de Microsoft para meter DDR3 (en lugar de GDDR5, que dicho sea de paso, hubiese sido lo logico, ya que Xbox360 usaba GDDR3) fue que en Epic pidieron 8GB de RAM y un rendimiento de 2,5 TeraFlops para mover el Unreal Engine 4 a 1080p (o 1,1TF a 720p, o si querias mantener 1080p y le quitaban la iluminacion por Voxeles y usaban un modelo de iluminacion mas modesto, como el Cone-lighting, podrias correrlo con 1,4TF. Si, la iluminacion por voxeles se come ella solita 1TeraFlop de proceso).

Los 2,5TF eran inalcanzables para cualquier sistema sub-600$, asi que fue directamente descartado. En su lugar se penso un sistema de 1,2TF, potencia suficiente para ejecutar UE4 a 720p y se contaria con la ayuda de la computacion en la nube para calcular la iluminacion. En ese caso, un juego basado en UE4 correria a 720p si se ejecutase offline, y a 1080p si podia usar computacion en nube.

Con respecto a los 8GB, los unicos modulos con los que conseguir mantener los costes bajo control, y conseguir un precio target de 500$ era la DDR3. Nadie, ni siquiera Samsung o Hinix (los mayores fabricantes mundiales de GDDR5) preveian fabricar modulos de 4Gbits a coste competitivo en la fecha de lanzamiento de la next-gen. Apostar por GDDR5 era demasiado arriesgado, y los fabricantes solo podian garantizar modulos de 2Gbit. Cabe aclarar que por temas electronicos, colocar mas de 16 chips de RAM es una apuesta MUY arriesgada. Montar modulos de 2Gbit (256MB por chip) habria supuesto colocar 32 de esos chips para conseguir 8GB, ¡Una solucion ARRIESGADISIMA!. Optar por la via de GDDR5 podria haber supuesto un precio de venta en la fecha de lanzamiento de mas de 800$ si se queria montar 8GB de GDDR5. La unica apuesta segura para un PVP objetivo de 500$ (e incluso de 400$, similar al precio de lanzamiento de X360) era usar DDR3.

Una vez que tenemos la potencia (1,2TF) y la RAM (8GB DDR3) hay que ponerse a desarrollar tecnologias para que eso no se atasque, y ahi si quehan dado el DO de pecho en MS. Han creado la mejor arquitectura con las armas de las que disponian. Han invertido mas de 3.000 millones con AMD trabajando codo con codo para desarrollar soluciones a los problemas, y han creado una consola 'preparada para el futuro'.

¿Se han equivocado? Eso solo el tiempo lo dira. De momento, sobre el papel, la apuesta es buena.

El caso según creo es que los Teraflops de la gráfica dejan de tener sentido cuando se complementa con coprocesadores, se optimiza la transferencia de datos entre las distintas partes (Move Engines), se aplica memoria Heterogénea (HSA), a la GPU se le aplican dos pipelines, optimizas la forma en la que se procesan las texturas (Tiled Resources) entre otras cosas.

La gráfica en sí si, tiene 1.31TF, pero el número real en rendimiento es mucho mayor debido a optimizaciones en la arquitectura.

f5inet:

fue que en Epic pidieron 8GB de RAM y un rendimiento de 2,5 TeraFlops para mover el Unreal Engine 4 a 1080p (o 1,1TF a 720p, o si querias mantener 1080p y le quitaban la iluminacion por Voxeles y usaban un modelo de iluminacion mas modesto, como el Cone-lighting, podrias correrlo con 1,4TF. Si, la iluminacion por voxeles se come ella solita 1TeraFlop de proceso).

Darkcaptain escribió:Strife 117 escribió:El caso según creo es que los Teraflops de la gráfica dejan de tener sentido cuando se complementa con coprocesadores, se optimiza la transferencia de datos entre las distintas partes (Move Engines), se aplica memoria Heterogénea (HSA), a la GPU se le aplican dos pipelines, optimizas la forma en la que se procesan las texturas (Tiled Resources) entre otras cosas.

La gráfica en sí si, tiene 1.31TF, pero el número real en rendimiento es mucho mayor debido a optimizaciones en la arquitectura.

Yo opino igual, aparte cuando se habló del UE4 y de lo que "necesitaba" es de hace tiempo, no creo que haya que medir las cosas actualmente solo con "números", por no hablar que los motores se suelen optimizar un pelín con el tiempo, las herramientas mejoran y con el tiempo siempre se acaban modificando ciertos aspectos del motor para llegar a encontrar un "equilibrio" (Visual vs rendimiento)

Por otra parte dejar claro lo siguiente:f5inet:

fue que en Epic pidieron 8GB de RAM y un rendimiento de 2,5 TeraFlops para mover el Unreal Engine 4 a 1080p (o 1,1TF a 720p, o si querias mantener 1080p y le quitaban la iluminacion por Voxeles y usaban un modelo de iluminacion mas modesto, como el Cone-lighting, podrias correrlo con 1,4TF. Si, la iluminacion por voxeles se come ella solita 1TeraFlop de proceso).

Esto es cierto, si, pero como la gente solo lee y entiende lo que quiere, voy a dejar claro que esto no significa que los juegos que usen UE4 vayan a ir todos a "720p" , no lo digo por f5inet que lo ha explicado bien, pero la gente leerá eso y pensará "vamos, que UE4 lo vamos a tener pero máximo a 720p" xDDDD

E incluso tardaremos varios años en ver un juego extrayendo el jugo al UE4 y ONE (GoW? Batman? no el Knight, otro, que este va con el UE3 -retocado- ...)

f5inet escribió:[

Para responder a eso deberiamos empezar a hablar de temas politicos y hacer unos pocos de brindis al sol, ya que no tengo el delorean por casa para saber el futuro, pero hablemos de ello.

La principal, y deberia decir PRINCIPAL (asi, en mayusculas) razon de Microsoft para meter DDR3 (en lugar de GDDR5, que dicho sea de paso, hubiese sido lo logico, ya que Xbox360 usaba GDDR3) fue que en Epic pidieron 8GB de RAM y un rendimiento de 2,5 TeraFlops para mover el Unreal Engine 4 a 1080p (o 1,1TF a 720p, o si querias mantener 1080p y le quitaban la iluminacion por Voxeles y usaban un modelo de iluminacion mas modesto, como el Cone-lighting, podrias correrlo con 1,4TF. Si, la iluminacion por voxeles se come ella solita 1TeraFlop de proceso).

Los 2,5TF eran inalcanzables para cualquier sistema sub-600$, asi que fue directamente descartado. En su lugar se penso un sistema de 1,2TF, potencia suficiente para ejecutar UE4 a 720p y se contaria con la ayuda de la computacion en la nube para calcular la iluminacion. En ese caso, un juego basado en UE4 correria a 720p si se ejecutase offline, y a 1080p si podia usar computacion en nube.

Con respecto a los 8GB, los unicos modulos con los que conseguir mantener los costes bajo control, y conseguir un precio target de 500$ era la DDR3. Nadie, ni siquiera Samsung o Hinix (los mayores fabricantes mundiales de GDDR5) preveian fabricar modulos de 4Gbits a coste competitivo en la fecha de lanzamiento de la next-gen. Apostar por GDDR5 era demasiado arriesgado, y los fabricantes solo podian garantizar modulos de 2Gbit. Cabe aclarar que por temas electronicos, colocar mas de 16 chips de RAM es una apuesta MUY arriesgada. Montar modulos de 2Gbit (256MB por chip) habria supuesto colocar 32 de esos chips para conseguir 8GB, ¡Una solucion ARRIESGADISIMA!. Optar por la via de GDDR5 podria haber supuesto un precio de venta en la fecha de lanzamiento de mas de 800$ si se queria montar 8GB de GDDR5. La unica apuesta segura para un PVP objetivo de 500$ (e incluso de 400$, similar al precio de lanzamiento de X360) era usar DDR3.

Una vez que tenemos la potencia (1,2TF) y la RAM (8GB DDR3) hay que ponerse a desarrollar tecnologias para que eso no se atasque, y ahi si quehan dado el DO de pecho en MS. Han creado la mejor arquitectura con las armas de las que disponian. Han invertido mas de 3.000 millones con AMD trabajando codo con codo para desarrollar soluciones a los problemas, y han creado una consola 'preparada para el futuro'.

¿Se han equivocado? Eso solo el tiempo lo dira. De momento, sobre el papel, la apuesta es buena.

@proj_spark and @linkinpark create the first-ever interactive music video, remixable in Project Spark http://mjr.mn/1l1fygT

A ver quien ve al desarrollador con la pantalla de xbox one y sunset overdrive y el kinect 2.0 en su mesa

f5inet escribió:ForzaThor escribió:f5inet , da gusto leerte, porque hasta un ignorante en estos temas como yo te entiende. Pero hay algo que llama mi curiosidad de absoluto desconocedor de estos temas.....si al final el resultado de una y otra consola van a ser parecidos ¿no es una perdida de tiempo desarrollar herramientas como dx12 (supongo que esto lleva una currada de la leche), hardware especifico para algunas tareas y demas cosas, si la otra al final va a tener los mismos resultados sin tantas vueltas?

Para responder a eso deberiamos empezar a hablar de temas politicos y hacer unos pocos de brindis al sol, ya que no tengo el delorean por casa para saber el futuro, pero hablemos de ello.

La principal, y deberia decir PRINCIPAL (asi, en mayusculas) razon de Microsoft para meter DDR3 (en lugar de GDDR5, que dicho sea de paso, hubiese sido lo logico, ya que Xbox360 usaba GDDR3) fue que en Epic pidieron 8GB de RAM y un rendimiento de 2,5 TeraFlops para mover el Unreal Engine 4 a 1080p (o 1,1TF a 720p, o si querias mantener 1080p y le quitaban la iluminacion por Voxeles y usaban un modelo de iluminacion mas modesto, como el Cone-lighting, podrias correrlo con 1,4TF. Si, la iluminacion por voxeles se come ella solita 1TeraFlop de proceso).

Los 2,5TF eran inalcanzables para cualquier sistema sub-600$, asi que fue directamente descartado. En su lugar se penso un sistema de 1,2TF, potencia suficiente para ejecutar UE4 a 720p y se contaria con la ayuda de la computacion en la nube para calcular la iluminacion. En ese caso, un juego basado en UE4 correria a 720p si se ejecutase offline, y a 1080p si podia usar computacion en nube.

Con respecto a los 8GB, los unicos modulos con los que conseguir mantener los costes bajo control, y conseguir un precio target de 500$ era la DDR3. Nadie, ni siquiera Samsung o Hinix (los mayores fabricantes mundiales de GDDR5) preveian fabricar modulos de 4Gbits a coste competitivo en la fecha de lanzamiento de la next-gen. Apostar por GDDR5 era demasiado arriesgado, y los fabricantes solo podian garantizar modulos de 2Gbit. Cabe aclarar que por temas electronicos, colocar mas de 16 chips de RAM es una apuesta MUY arriesgada. Montar modulos de 2Gbit (256MB por chip) habria supuesto colocar 32 de esos chips para conseguir 8GB, ¡Una solucion ARRIESGADISIMA!. Optar por la via de GDDR5 podria haber supuesto un precio de venta en la fecha de lanzamiento de mas de 800$ si se queria montar 8GB de GDDR5. La unica apuesta segura para un PVP objetivo de 500$ (e incluso de 400$, similar al precio de lanzamiento de X360) era usar DDR3.

Una vez que tenemos la potencia (1,2TF) y la RAM (8GB DDR3) hay que ponerse a desarrollar tecnologias para que eso no se atasque, y ahi si quehan dado el DO de pecho en MS. Han creado la mejor arquitectura con las armas de las que disponian. Han invertido mas de 3.000 millones con AMD trabajando codo con codo para desarrollar soluciones a los problemas, y han creado una consola 'preparada para el futuro'.

¿Se han equivocado? Eso solo el tiempo lo dira. De momento, sobre el papel, la apuesta es buena.

Arnau134 escribió:f5inet escribió:[...]

Una vez que tenemos la potencia (1,2TF) y la RAM (8GB DDR3) hay que ponerse a desarrollar tecnologias para que eso no se atasque, y ahi si quehan dado el DO de pecho en MS. Han creado la mejor arquitectura con las armas de las que disponian. Han invertido mas de 3.000 millones con AMD trabajando codo con codo para desarrollar soluciones a los problemas, y han creado una consola 'preparada para el futuro'.

¿Se han equivocado? Eso solo el tiempo lo dira. De momento, sobre el papel, la apuesta es buena.

Perdona mi incultura, pero Xbox One no tiene 1.32 TFlops? No la subieron la GPU con un OC?

[...]

f5inet escribió:Arnau134 escribió:f5inet escribió:[...]

Una vez que tenemos la potencia (1,2TF) y la RAM (8GB DDR3) hay que ponerse a desarrollar tecnologias para que eso no se atasque, y ahi si quehan dado el DO de pecho en MS. Han creado la mejor arquitectura con las armas de las que disponian. Han invertido mas de 3.000 millones con AMD trabajando codo con codo para desarrollar soluciones a los problemas, y han creado una consola 'preparada para el futuro'.

¿Se han equivocado? Eso solo el tiempo lo dira. De momento, sobre el papel, la apuesta es buena.

Perdona mi incultura, pero Xbox One no tiene 1.32 TFlops? No la subieron la GPU con un OC?

[...]

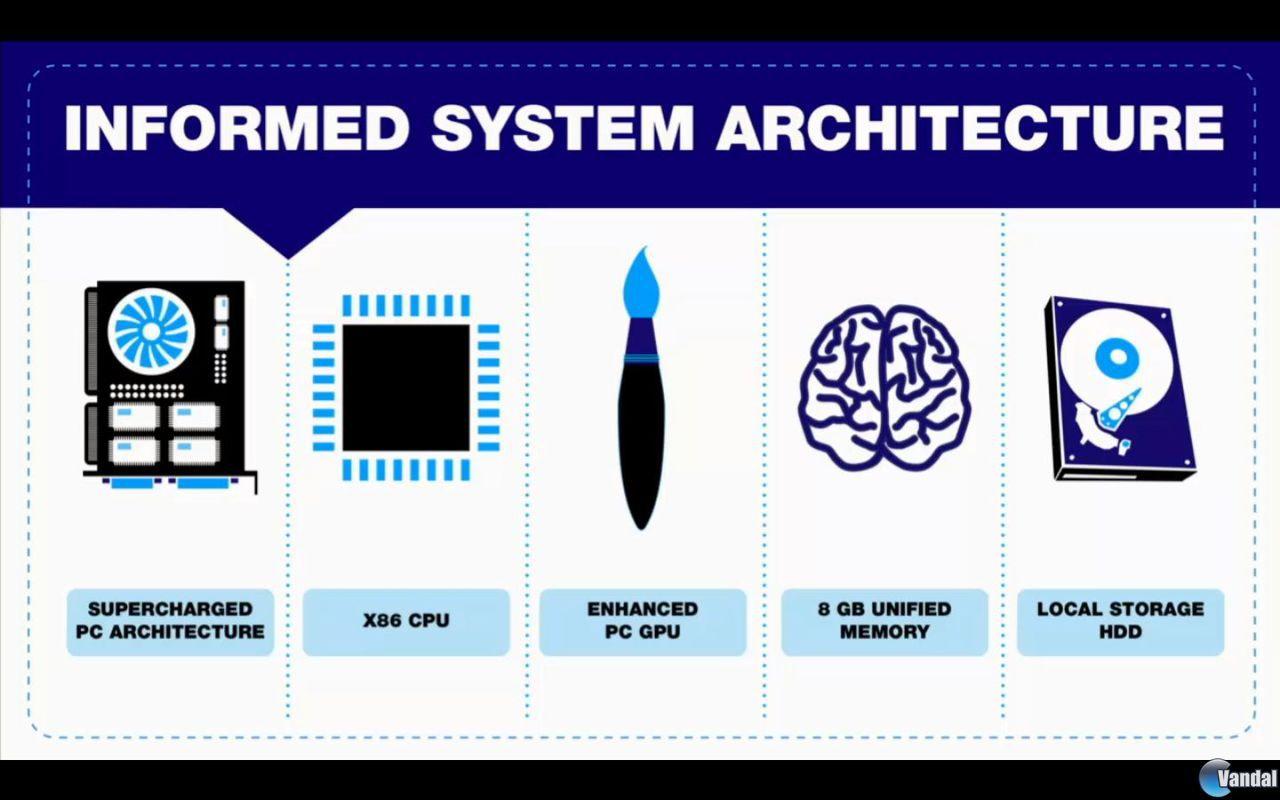

Quedas totalmente perdonado hombre. En realidad, la apuesta de Microsoft era el caballo ganador en todas las quinielas. pero se convirtio en perdedora cuando sony presento esto:

Una maquina mas barata, con 8GB de RAM y una GPU mas potente. Aqui entro en juego el control de daños de Microsoft. la GPU de XboxONE tiene 14CUs, de los cuales solo estan activos 12 (desactivan 2 por motivos de aprovechar el yield, al estilo PS3, que de los 8 SPE solo tenian activos 7), mientras que PS4 tiene 20CUs de los cuales solo estan activos 18 (desactivan 2 por identica razon).

XboxONE=12CUs=1,2TF

PS4=18CUs=1,8TF

¿veis la relacion? no es vano, ambas GPUs son 'AMD-based'.

Ante este problema, Microsoft tenia dos posibilidades para aumentar la potencia de XboxONE (Recordad que la consola YA se estaba fabricando. cambiar la especificacion hubiese supuesto tirar las ya fabricadas y retrasar el producto un año como minimo, dando una ventaja inadmisible a PS4), o bien activaban 1 o 2 CUs mas, a costa de tirar APUs a la basura que no llegaran a los CUs requeridos, o aumentaban la frecuencia.

- Activar un CU adicional suponia tener que volver a testear todas las APUs, comerse aproximadamente un 4% mas de APUs defectuosas, aparte que se encontraria con una potencia de 1,3TF.

- Aumentar la frecuencia se podia realizar via actualizacion de Software (La actualizacion DayOne), las averias por falta de heat-room podrian gestionarse por SAT (ratio de averias estimado Sigma5, 0,01%), y ademas la salida se realizaria casi exclusivamente en el hemisferio norte en una epoca en la que es invierno. la potencia que se alcanzaria seria de 1,31TF.

un 4% de producto defectuoso, contra un 0,01%... la decision esta clarisima.

La ventaja adicional, es que el hecho de meter la eSRAM en el SoC, que en principio fue un parche a la lentitud de la DDR3, lo han convertido en un abanico inmenso de posibilidades que no pueden ser copiadas por el rival directo, pero yo remarcaria 3:

- Tiled Rendering (que no tiled resurces o PRT. Los curiosos, revisad bibliografia de PowerVR Kyro II, o como una GPU 4 veces inferior a una Geforce 3 igualaba su fillrate en pantalla)

- Compressed Textures (Data Move Engines con LZ/JPEG decode/encode)

- Controlador Ethernet integrado en el SoC y no en el southbirdge como la competencia (eso es apostar por la nube, y lo demas son tonterias)

Los Tiled Resources o PRT pueden ser usados por ambas arquitecturas. bajo mi modesta opinion, XboxONE esta mas preparada para Tiled Resources/PRT que PS4 (mas que nada porque el Atlas de Texturas se puede almacenar en la eSRAM, con penalizaciones por acceso al atlas practicamente a cero), pero como poder, ambas pueden.

sdja4 escribió:Vaya pedazo de juego el tomb raider, me encanto. Como tengo la cuenta compartida lo comprare por 11€.

Game Cube escribió:sdja4 escribió:Vaya pedazo de juego el tomb raider, me encanto. Como tengo la cuenta compartida lo comprare por 11€.

Como funciona el tema de compartir cuentas? Cuantos usuarios por cuenta? Gracias.

CISKO escribió:este tio sabe

![pelota [boing]](/images/smilies/nuevos/pelota_ani1.gif)

![pelota [boing]](/images/smilies/nuevos/pelota_ani1.gif) .

. ![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

Jonystilo escribió:Ya nadie tiene huevos a postear![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

Entre f5inet y Ferdopa... A ver quién los tiene.

Lo que comenta Ferdopa es un tema que puede generar muchas críticas de ser así como lo ha expuesto. Si con la nube puede mejorar mucho la cosa, como afectará a los que no tengan conexión? En qué condiciones jugaremos?

Un saludo.

URTYK escribió:La idea es dar un paso atrás (lo que ya se hizo por el tema del DRM y tal) para dar 2 adelante.

Hoy mismo salia una entrevista a Phil Spencer, en Gamespot, diciendo que siguen teniendo en mente el préstamo y los regalos de juegos.

Cómo ya sabíamos, la idea era de poder compartir la biblioteca de juegos con hasta 10 personas más, quizás ahora que la gente "comparte" su consola, se vea desde otra perspectiva, que dejen este sistema 2 años o así y luego anuncien un cambio.

"Estamos pensando en construir el futuro de mercado digital para lo que la gente espera, y con suerte algunas cosas que harán las delicias más allá de sus expectativas "

Cómo ha dicho Ferdopa, si One estaba pensada, diseñada y construida para estar siempre conectada y poder usar computación en la nube, Microsoft necesita dar al usuario una excusa muy buena para tenerla siempre ON.

Aunque hay alguien que no la tenga conectada ?

![Adorando [tadoramo]](/images/smilies/adora.gif)

f5inet escribió:URTYK escribió:La idea es dar un paso atrás (lo que ya se hizo por el tema del DRM y tal) para dar 2 adelante.

Hoy mismo salia una entrevista a Phil Spencer, en Gamespot, diciendo que siguen teniendo en mente el préstamo y los regalos de juegos.

Cómo ya sabíamos, la idea era de poder compartir la biblioteca de juegos con hasta 10 personas más, quizás ahora que la gente "comparte" su consola, se vea desde otra perspectiva, que dejen este sistema 2 años o así y luego anuncien un cambio.

"Estamos pensando en construir el futuro de mercado digital para lo que la gente espera, y con suerte algunas cosas que harán las delicias más allá de sus expectativas "

Cómo ha dicho Ferdopa, si One estaba pensada, diseñada y construida para estar siempre conectada y poder usar computación en la nube, Microsoft necesita dar al usuario una excusa muy buena para tenerla siempre ON.

Aunque hay alguien que no la tenga conectada ?

Hay gente mu rara... fijate que hay gente que tiene desconectado el Kinect...

f5inet escribió:Jonystilo escribió:Ya nadie tiene huevos a postear![más risas [+risas]](/images/smilies/nuevos/risa_ani3.gif)

Entre f5inet y Ferdopa... A ver quién los tiene.

Lo que comenta Ferdopa es un tema que puede generar muchas críticas de ser así como lo ha expuesto. Si con la nube puede mejorar mucho la cosa, como afectará a los que no tengan conexión? En qué condiciones jugaremos?

Un saludo.

sin la nube jugaras a 720p. con la nube jugaras a 1080p (y con mejor IA, iluminacion y fisicas, incluso). tan sencillo como eso. Aparte, si el juego que estas usando ES multijugador, ya estas conectado a internet, asi que... Blanco y en botella...

![toma [tomaaa]](/images/smilies/nuevos2/tomaa.gif)

jvg escribió:Hola ,esta noche no me deja entrar en los servidores de los juegos, a alguien mas le pasa? En la web del live dice que hay un problema.

http://support.xbox.com/es-ES/xbox-live ... url_status

ESPMuD-XBONE escribió:La normalidad debe ser la realidad aceptada por la mayoría. La confortable.

La gente vendiendo tarjetas Titan, GDDR, y resulta que Microsoft con peor hardware va a ser mejor.

ESPMuD-XBONE escribió:La normalidad debe ser la realidad aceptada por la mayoría. La confortable.

La gente vendiendo tarjetas Titan, GDDR, y resulta que Microsoft con peor hardware va a ser mejor.

ESPMuD-XBONE escribió:La normalidad debe ser la realidad aceptada por la mayoría. La confortable.

La gente vendiendo tarjetas Titan, GDDR, y resulta que Microsoft con peor hardware va a ser mejor.

ESPMuD-XBONE escribió:La normalidad debe ser la realidad aceptada por la mayoría. La confortable.

La gente vendiendo tarjetas Titan, GDDR, y resulta que Microsoft con peor hardware va a ser mejor.

ESPMuD-XBONE escribió:Papatuelo, no me faltes al respeto, y más cuando me has preguntado en otras ocasiones. Además, si fuese como tú dices, seguiría con la 360. Pero viendo tus "argumentos" pues lo dicho.

Por usar falaz no se lleva más razón. Al final la cosa es que por ahorrar costes, por falta de previsión y lo que queráis se ha montado un hardware un tanto regulero, que no malo.

ESPMuD-XBONE escribió:Siguiendo el símil, le pongo un motor Seat 127 a un Ferrari, le echo gasolina de avión y ya es igual.

Yo creo que lo de nueva generación es marketing. Ni la WiiU, ni PS4, ni One son otra cosa que PCs de gama media. Por costes y por compatibilidad para programar. Nos hemos comprado un pc nuevo para jugar, con respecto a nuestras antiguas consolas.

![Adorando [tadoramo]](/images/smilies/adora.gif) (y no tanto juego medieval o ciencia ficción que ya cansan xD)

(y no tanto juego medieval o ciencia ficción que ya cansan xD) Darkcaptain escribió:ESPMuD-XBONE escribió:Siguiendo el símil, le pongo un motor Seat 127 a un Ferrari, le echo gasolina de avión y ya es igual.

Yo creo que lo de nueva generación es marketing. Ni la WiiU, ni PS4, ni One son otra cosa que PCs de gama media. Por costes y por compatibilidad para programar. Nos hemos comprado un pc nuevo para jugar, con respecto a nuestras antiguas consolas.

Quien ha dicho que PS4 o ONE sean equivalentes a un PC de Gama Alta y con una Titan? xD

Lo que parece mentira es que algunos no sepan que a un Hardware cerrado se le da mucho mas rendimiento que un "PC convencional", o acaso con un PC del 2005 serías capaz de hacer funcionar Gears of War 3 con 512 mb de RAM -con la misma calidad visual que en X360-? o un Bioshock Infinite? o un Tomb Raider? sigo?

Aquí nadie está diciendo que ONE sea capaz de mover el próximo Crysis (me lo invento) en detalle Ultra, 1080p y AA al tope, lo que se está diciendo es que Ryse a día de hoy es un juego que es de lo mejorcito que se ha visto (visualmente) en cuanto a videojuegos y no está aprovechando nada los recursos de la ONE, entonces ya es de imaginar que lo que podríamos ver en 3 añitos son cosas muy bestias... (SDK decentes + DX12 + motores next-gen + estudios haciendo uso de eSRAM y otras palabrerías técnicas, conociendo realmente las nuevas maquinas).

Que el hardware de PS4 y One no sea muy allá está claro, APU's... cualquier PC con i5 (ya no digo i7) y una gráfica de gama media en potencia bruta se las "fo***" pero como siempre, la optimización siempre tiene la parte mas importante.

Algunos habláis como si hubiéramos visto la potencia de la ONE en tan solo 4 meses.. y es todo lo contrario, el 99% de los juegos son Crossgren (Cutre-ports) con motores pensados para X360/PS3, que en su versión para ONE le han metido mejores efectos y aumentado la resolución, nada mas.

El tema de la nube (en juegos) no soy muy optimista, yo creo que si llegamos a ver algo será en temas de iluminación y demás.. pero poco mas, y llegar a tener servidores dedicados decentes en muchas regiones, que controlen I.A. etc.. etc.. algo que hemos empezado a ver en Titanfall pero mas "profundo". Sigo soñando con 1 MMO-RPG enfocado en una Prisión totalmente next-gen(y no tanto juego medieval o ciencia ficción que ya cansan xD)