El uso de técnicas de supersampling para elevar la resolución gráfica final de escenarios de realidad virtual no es nueva, pero la complejidad de los cálculos necesarios para implementarla ha hecho que muchos desarrolladores se inclinen por explorar vías como el renderizado foveado, que sigue los ojos del usuario para reducir el detalle gráfico ahí donde la vista no presta atención. La técnica desarrollada por Facebook es radicalmente distinta.

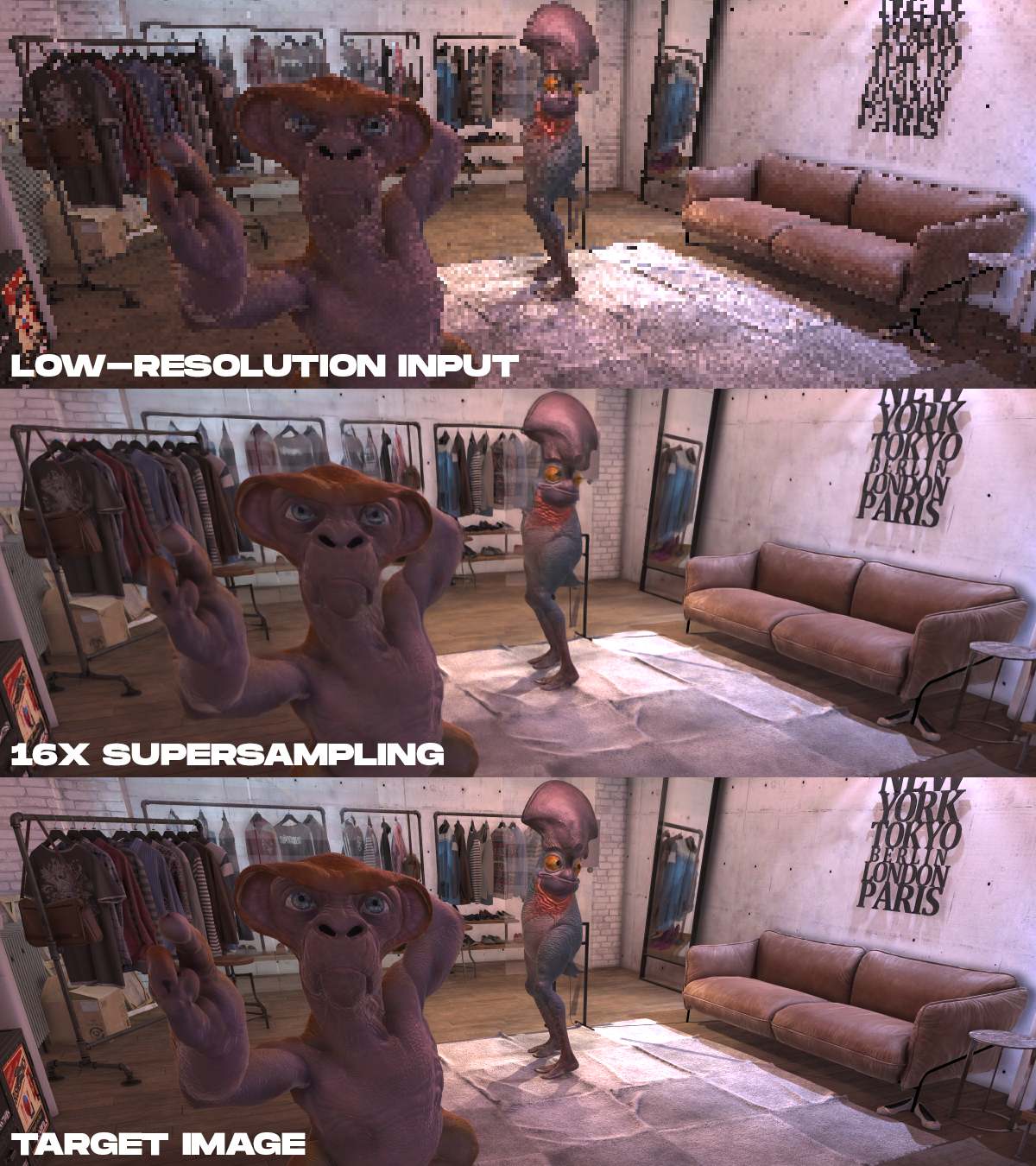

El paper publicado por Facebook Research describe el uso de redes neuronales para introducir una imagen a muy baja resolución y reconstruirla con hasta dieciséis veces más píxeles, generando de nuevo los detalles perdidos mediante una inteligencia artificial entrenada con imágenes nativas a alta resolución. Dicho de forma muy simplificada, el ordenador o visor autónomo renderiza en realidad una imagen a baja resolución que después es escalada a alta resolución mediante IA.

Más de un jugador estará teniendo un dejá vu en estos momentos. A grandes rasgos (e incluso no tan grandes), el funcionamiento de la tecnología de Facebook es análogo al Deep Learning Super Sampling o DLSS incorporado por Nvidia en sus tarjetas GeForce RTX, pero según los ingenieros de la red social, su método introduce menos artefactos visuales y no utiliza "tecnologías propietarias y/o hardware que pueden no estar disponibles en todas las plataformas".

La descripción inicial del paper detalla que el supersampling de Facebook es "fácil de integrar en motores de juego modernos", aunque todavía está muy lejos de poder ser explotado comercialmente. Aún debe ser refinado y aún queda la duda del hardware necesario (las pruebas de entrenamiento neuronal y generación se realizaron con una GeForce Titan V), pero a priori parece una técnica prometedora, tanto en solitario como potencialmente en combinación con otras como el foveado.